Parole Chiave per la Valutazione degli LLM

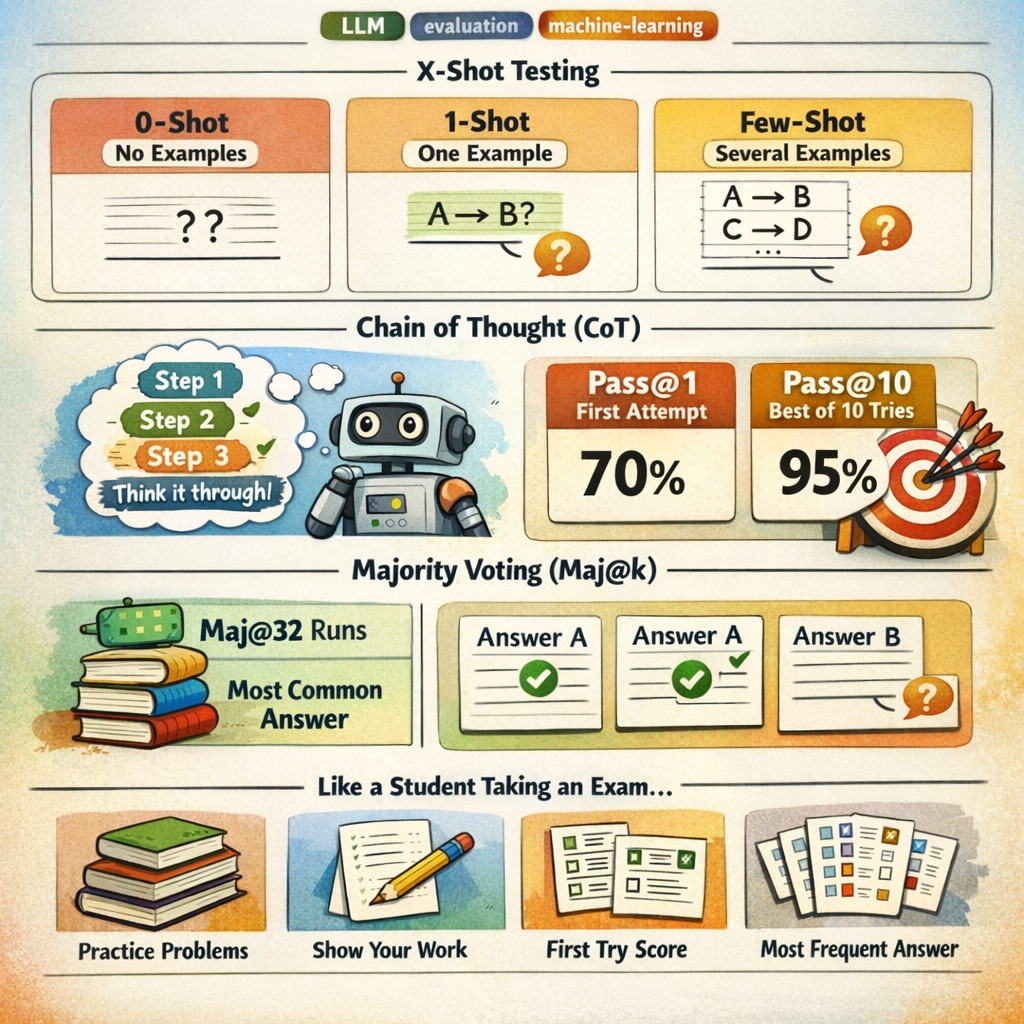

x-shot

Il numero di esempi forniti nel prompt prima di chiedere al modello di rispondere. 0-shot significa nessun esempio — stai testando la conoscenza grezza del modello. 1-shot fornisce un esempio. Few-shot ne fornisce diversi.

Più esempi generalmente migliorano le performance, ma 0-shot testa ciò che il modello sa davvero rispetto a ciò che può dedurre per pattern-matching dagli esempi.

CoT (Chain of Thought)

Una tecnica di prompting che incoraggia il ragionamento passo dopo passo prima di dare una risposta finale. Invece di saltare alla conclusione, il modello elabora il problema esplicitamente.

Questo migliora le performance perché costringe il modello a generare più token di ragionamento — e nelle architetture transformer, più computazione prima della risposta significa risposte migliori.

Pass@k

Una metrica di valutazione che mostra il tasso di successo su tentativi multipli. Pass@1 è la percentuale di risposte corrette al primo tentativo. Pass@10 verifica se uno qualsiasi dei 10 tentativi produce una risposta corretta.

Un alto pass@1 con pass@10 ancora più alto suggerisce che il modello può risolvere il problema ma non è affidabile nel farlo.

Maj@k (Majority Voting)

Verifica se la maggioranza dei tentativi multipli converge sulla stessa risposta. Maj@32 esegue il modello 32 volte e prende la risposta più comune.

Questo valuta la robustezza: un modello che dà la stessa risposta (corretta) consistentemente è più affidabile di uno che occasionalmente la indovina per caso.

Mettiamo tutto insieme

Pensalo come uno studente che fa un esame:

- Shots = quanti problemi di pratica vedono prima del test

- CoT = se mostrano il procedimento

- Pass@1 = hanno risposto correttamente al primo tentativo?

- Maj@32 = se facessero l’esame 32 volte, quale risposta darebbero più spesso?